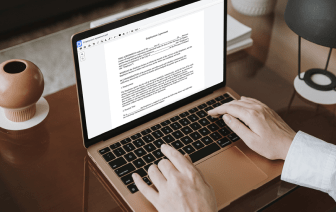

Cuando tu trabajo diario consiste en mucha edición de documentos, ya sabes que cada formato de documento requiere su propio enfoque y, a menudo, aplicaciones particulares. Manejar un archivo NB aparentemente simple puede detener todo el proceso, especialmente si intentas editar con herramientas inadecuadas. Para prevenir tales dificultades, consigue un editor que pueda cubrir todos tus requisitos sin importar la extensión del archivo y ajustar oraciones en NB sin obstáculos.

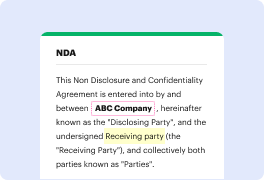

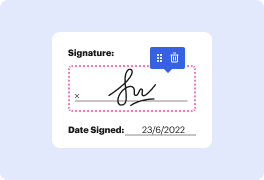

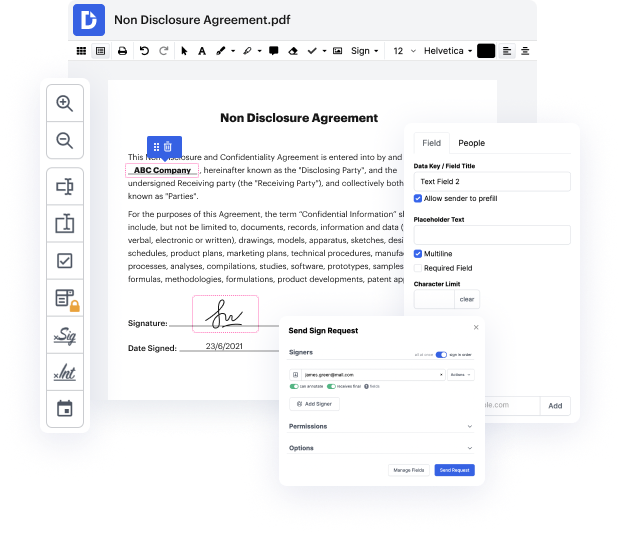

Con DocHub, trabajarás con una herramienta de edición multifuncional para prácticamente cualquier ocasión o tipo de documento. Reduce el tiempo que solías gastar navegando por la funcionalidad de tu antiguo software y aprende de nuestra interfaz de usuario intuitiva mientras realizas el trabajo. DocHub es una plataforma de edición en línea optimizada que maneja todos tus requisitos de procesamiento de documentos para cualquier archivo, como NB. Ábrelo y ve directamente a la productividad; no se requiere capacitación previa ni leer manuales para disfrutar de los beneficios que DocHub aporta al procesamiento de la gestión de documentos. Comienza tomando unos momentos para registrar tu cuenta ahora.

Ve mejoras en el procesamiento de tus documentos inmediatamente después de abrir tu perfil de DocHub. Ahorra tiempo en la edición con nuestra solución única que te ayudará a ser más productivo con cualquier formato de documento con el que tengas que trabajar.

hola, bienvenido al video, vamos a cubrir cómo podemos entrenar un modelo mejor o un transformador de oraciones o un modelo de oraciones mejor utilizando lo que es una especie de la forma original de entrenar estos modelos de ajuste fino de estos modelos, que es utilizando la pérdida softmax, así que comencemos con una rápida visión general del enfoque de entrenamiento [Música] [Aplausos] [Música] [Aplausos] [Música] ahora, utilizar el enfoque de entrenamiento softmax es parte de lo que podríamos llamar el enfoque de inferencia de lenguaje natural para el ajuste fino de estos modelos y dentro de esa categoría de entrenamiento tenemos dos enfoques, tenemos la pérdida softmax o la pérdida de clasificación softmax que vamos a cubrir y luego también tenemos algo llamado una pérdida de clasificación de múltiples negativos, ahora en realidad probablemente no usarías la pérdida softmax porque simplemente no es tan buena como usar la otra forma de pérdida de múltiples negativos, la llamaré m r de ahora en adelante, así que m r es más efectivo, pero la pérdida softmax es así