¿Alguna vez has tenido problemas para modificar tu documento NB mientras estás en movimiento? ¡Bueno, DocHub tiene una gran solución para eso! Accede a este editor en la nube desde cualquier dispositivo conectado a internet. Permite a los usuarios aplicar marcas de agua en archivos NB de forma rápida y siempre que sea necesario.

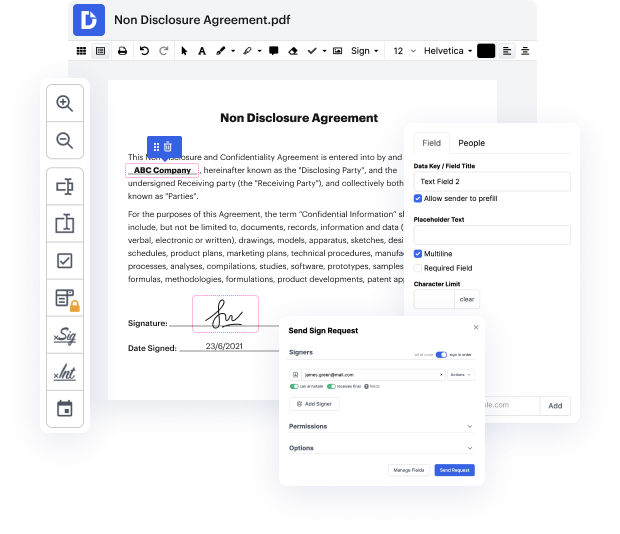

DocHub te sorprenderá con lo que te ofrece. Tiene una funcionalidad robusta para hacer cualquier actualización que desees en tu documentación. Y su interfaz es tan fácil de usar que todo el proceso de principio a fin te llevará solo unos pocos clics.

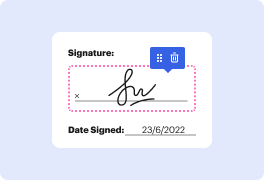

Una vez que completes los ajustes y compartas, puedes guardar tu documento NB actualizado en tu dispositivo o en la nube tal como está o con un Registro de Auditoría que contenga todas las modificaciones aplicadas. Además, puedes guardar tu documentación en su versión inicial o convertirla en una plantilla de uso múltiple - completa cualquier tarea de gestión de documentos desde cualquier lugar con DocHub. ¡Regístrate hoy!

la pantalla es tuya hola a todos mi nombre es mehti y estoy muy feliz de estar aquí en este seminario web estamos hablando sobre cómo proteger el modelo de entrenamiento de la infracción de derechos de autor y cómo podemos marcar con agua redes neuronales profundas textuales uh está bien en esta presentación uh primero hablaré sobre uh la introducción y la declaración del problema luego describiré el método propuesto después de eso se mostrarán los resultados experimentales y finalmente terminaré el seminario web presentando conclusiones y trabajos futuros uh comencemos con uh la introducción las redes neuronales profundas han obtenido resultados de vanguardia en muchos dominios de aprendizaje automático desde nlp para clasificación de imágenes y texto ya que hardware sofisticado y potente gran cantidad de datos etiquetados y experiencia humana ayudan a dna a tener un resultado tan excelente así que podemos considerar uh entrenar redes neuronales profundas como propiedad intelectual uh el ajuste fino es una técnica efectiva para acelerar el entrenamiento y la fase de los modelos dnn y también es útil para superar pequeños datos